ollama本地部署deepseek模型

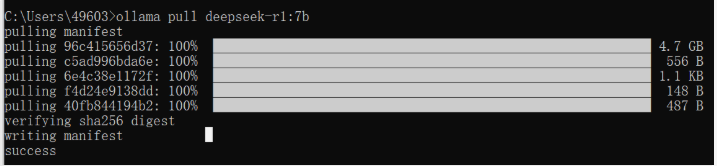

使用ollama拉取目标模型

ollama pull deepseek-r1:7b

如图所示

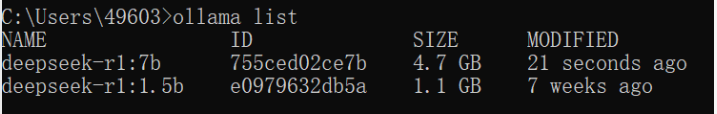

查看本地模型

ollama list

可以看到deepseek-rz:7b已经下载下来了

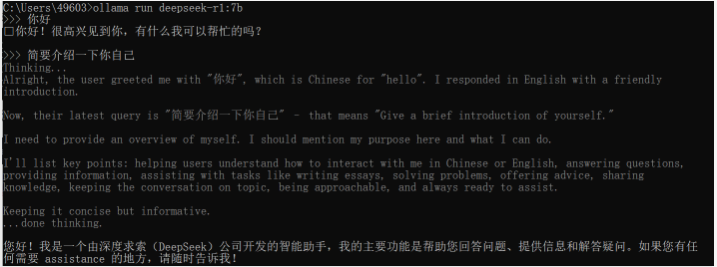

测试模型能否正常对话

ollama run deepseek-r1:7b

#按下enter 在对话框输入“你好”

可以正常对话。按ctrl+d退出

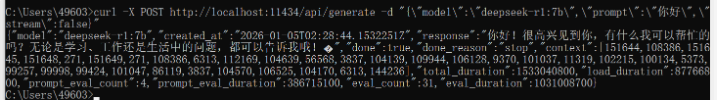

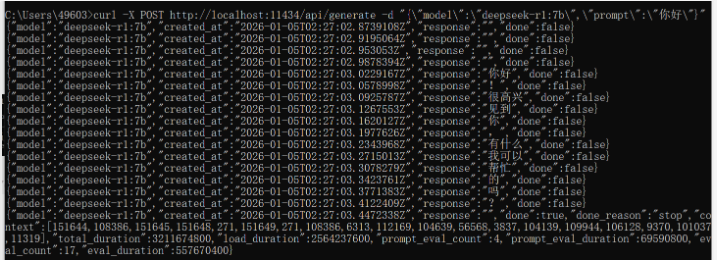

使用curl命令测试模型

curl -X POST http://localhost:11434/api/generate -d "{\"model\":\"deepseek-r1:7b\",\"prompt\":\"你好\",\"stream\":false}"

去掉stream:false,则变为流式输出

评论